|

||||||

|

||||||

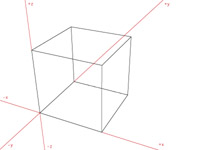

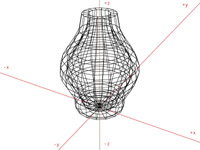

| Vom Byte zum Bild Was ist 3-D-Rendering? Das englische „to render“ bedeutet „machen, erstellen“. Wie die Camera obscura einen wirklichen, dreidimensionalen Raum zweidimensional abbildet, erstellt der Computer Pixel für Pixel (Bildpunkt) ein zweidimensionales Bild aus einer dreidimensionalen Raumbeschreibung. Diese 3-D-Raumdefinition ist eine mathematische Beschreibung von Gegenständen, Oberflächen und Lichtquellen in einem Koordinatenraum. Während des Renderings tastet der Computer die Bildpunkte zeilenweise ab und ordnet jedem Pixel einen bestimmten Farbwert zu. Der Farbwert wird anhand der Informationen der 3-D-Raumdefinition festgelegt: Wie ist der Körper beschaffen, welche Oberfläche hat er, woher kommt das Licht? Obwohl der Vorgang der eigentlichen Bildgenerierung abstrakt und mechanisch ist, hat das Arbeiten am Computer Ähnlichkeit mit herkömmlichen Verfahren wie Modellbau, Bühnenbild oder Setdesign beim Film. Eine Szene wird gebaut, Oberflächen werden bearbeitet, die Objekte werden positioniert und Lichter werden gesetzt. Im virtuellen Raum des Computers sind jedoch endlose Optimierungen möglich. Eine Szene kann hundertmal umgebaut werden und ist doch immer neu – Daten altern nicht. Die Programme, die heute für die Bildgenerierung zur Verfügung stehen, sind Nachfolger der z.B. in Architektur, Industrie- und Produktdesign verwendeten CAD(Computer Aided Design)-Programme, in denen Gegenstände entworfen und simuliert werden können. Von der Vorstellung zum Bild – Plastisches Arbeiten Von der Bildvorstellung ausgehend werden der zu generierende Raum und die darin befindlichen Gegenstände zunächst als Drahtgittermodelle erzeugt. Die einzelnen Punkte der Drahtgitternetze werden mithilfe geometrischer Koordinaten festgelegt. Die Ecken eines Würfels mit der Kantenlänge 1 und einer Ecke am Ursprung haben z. B. folgende Koordinaten: 0,0,0; 0,0,1; 0,1,0; 0,1,1; 1,0,0; 1,1,0; 1,0,1; 1,1,1.  Zum Erstellen von Drahtgittermodellen gibt es in einem Programm eine Vielzahl von Werkzeugen. Einige dieser Werkzeuge besitzen analoge Vorbilder; mithilfe des Lathe-tools („Drechselwerkzeug“) etwa entstehen aus Profillinien durch Rotation dreidimensionale Objekte wie z.B. eine Vase.   Durch Extrudieren eines Kreises kann eine Säule gefertigt werden. Darüberhinaus gibt es komplexere Modellierungsformen, die eher an das Arbeiten mit Ton erinnern und mit deren Hilfe auch komplizierter strukturierte Körper, z.B. Gesichter, geformt werden können. Mit Boolschen Operationen sind Addition, Subtraktion und Schnittmengen von Körpern möglich; so ließen sich die Löcher im Käse modellieren. Diese Arbeitsphase kann man auch als „digitale Bildhauerei“ bezeichnen.  Gestaltung der Oberflächen Zu diesem Zeitpunkt sind die modellierten Gegenstände nur als Gerüste sichtbar; erst das Auflegen von Oberflächen und das Festlegen der Beleuchtung geben dem Körper seine räumliche Gestalt. Ein Objekt kann glatt, rauh oder mit einer reliefartigen Oberfläche, z.B. Rauhfasertapete oder Stofftextur, überzogen werden. Die Bumps (Höhen und Tiefen) der Oberfläche werden hierbei nur simuliert, was sie von den echten Vertiefungen eines Objekts unterscheidet, die während der Modellierungsphase festgelegt werden. Die Modellierung einer Oberflächenfeinstruktur (z.B. Holzmaserung, Rauhputz) wäre zu aufwendig und würde endlose Rechenzeiten mit sich bringen. Weitere Parameter für die Gestaltung von Oberflächen wie Glanz und Färbung lassen sich entweder gleichmäßig einstellen oder – durch Shader oder Maps – ungleichmäßig strukturieren. Dadurch kann z.B. der Glanz einer Oberfläche punktuell variiert werden. Shader sind kleine Programmmodule, die bestimmte Texturen simulieren können. Eine Backsteinmauer z.B. ist solch ein kleines Modul, das in allen Renderingprogrammen enthalten ist. Farbe, Anordnung, Größe der Backsteine und Fugen können je nach Wunsch eingestellt werden. Durch die Verwendung von Maps kann eine noch realistischere Oberfläche geschaffen werden; hierbei wird ein kleiner, nahtlos kachelbarer Texturausschnitt vielfach auf einen Körper aufgelegt. Die Ränder einer Map passen jeweils aneinander. Maps können auch selbst angefertigt werden; für eine hochauflösende Holzoberfläche z.B. wird ein Stück Furnier mit gleichmäßiger Struktur eingescannt und die so erstellte Bilddatei weiterbearbeitet, bis die Ränder nahtlos aneinander anschließen.  Weitere Einstellungsmöglichkeiten sind Transparenz und Brechungsindex der Oberflächen. Im Texturinterface (Bedienungsfeld) wird festgelegt, wieviel Licht von einer Oberfläche absorbiert und wieviel reflektiert wird. Es können auch Oberflächen erstellt werden, die so in der Realität nicht vorkommen, z. B. eine Fläche, die hochglänzend ist und alle Lichtquellen reflektiert, in der jedoch nicht die Umgebung gespiegelt wird. Da die Lichteinwirkung auf eine Oberfläche in drei Kategorien unterteilt wird (diffuses, reflektiertes und gerichtetes Licht), lassen sich auch Oberflächen definieren, die eine Lichtart reflektieren, eine andere dagegen nicht. Ebenso kann festgelegt werden, ob, auf welche Weise und wohin ein Objekt Schatten wirft. Nach der Festlegung der Oberflächentexturen erfolgt das Mapping. Hierbei wird definiert, auf welche Art die Textur auf den Körper aufgelegt wird. Beim kubischen Mapping wird die Oberfläche von sechs Seiten aus auf den Gegenstand projiziert (analog zu einem Würfel: oben, unten, rechts, links, vorn und hinten).  Diese Art des Mappings läßt sich jedoch nicht auf gerundete, unregelmäßige oder organische Körper anwenden. Hierfür gibt es speziellere Mappingverfahren, wie z.B. das parametrische Mapping, die der Form eines Objekts folgen können. Auch eine Überlagerung von Texturen ist möglich, z.B. ein Graffito auf einer Hauswand. Als nächster Schritt wird die Renderingposition mit Blickrichtung und -winkel festgelegt, also die Kameraposition und Objektivbrennweite. Im Gegensatz zur Realität gibt es im virtuellen Raum absolute Tiefenschärfe. Eine Oberfläche, die sich nur wenige Millimeter von der Renderingposition entfernt befindet, ist ebenso scharf gezeichnet wie ein Gegenstand, der im Bildhintergrund zu sehen ist. Lichtkomposition Bei der digitalen Bilderstellung können verschiedene Lichttypen eingesetzt werden, um Räumlichkeit zu simulieren. Beim Sonnenlicht fallen die Lichtstrahlen parallel und das Licht nimmt mit der Entfernung von der Lichtquelle nicht ab. Beim Punktlicht stahlt das Licht in alle Richtungen gleichmäßig ab und die Intensität verringert sich mit dem Quadrat der Entfernung. Der Scheinwerfer ähnelt dem Punktlicht, die Abstrahlung ist jedoch auf einen Kreis von variabler Größe beschränkt. Daneben existieren Sonderlichter wie z.B. der Diaprojektor, mit dem sich ein leuchtendes Bild projizieren läßt. Für jeden einzelnen Lichttyp können Intensität, Lichtfarbe und Schattenwurf (hart oder weich) festgelegt werden. Beim einfachen Beleuchtungsmodell werden die Abstrahlungen der verschiedenen Lichtquellen und ein gleichmäßiges Grundlicht eingearbeitet. Andere Beleuchtungsmodelle, wie z. B. Radiosity, berücksichtigen die Interaktion der beleuchteten Oberflächen untereinander. Ein roter Vorhang hinterläßt einen roten Schein auf einer weißen Wand, die wiederum den Vorhang aufhellt. Solche komplexen Beleuchtungsverfahren erfordern natürlich auch entsprechend mehr Rechenzeit. Fertigstellung des Bildes Mit Feinabstimmungen von Bildkomposition, Textur und Licht, die mit häufigen Proberenderings einhergehen, nähert man sich langsam der ursprünglichen oder inzwischen modifizierten Bildvorstellung an; in dieser Phase sind noch immer Änderungen aller Art am Bild möglich. Als letzter Schritt erfolgt das Rendering der eigentlichen Belichtungsdatei, das je nach Komplexität des Bildes bis zu mehreren Wochen dauern kann. Um einen hochauflösenden Abzug zu erhalten, wird die Datei anschließend in ein Großlabor gebracht. Mithilfe eines Dreifarblasers wird die Fotopapieroberfläche zeilenweise Pixel für Pixel belichtet. Dieser Print wird dann auf konventionelle Art entwickelt und aufgezogen. Hier findet der Übergang von digital zu analog, von der kopierbaren Datei zum Kunstwerk statt. Original und Kopie Ähnlich wie bei der Fotografie gibt es bei auf digitalen Medien basierender Kunst keine Originale im klassischen Sinne, da von einer Bilddatei beliebig viele Ausbelichtungen angefertigt werden können – eine jede die exakte Reproduktion der ursprünglichen Datei. Eine Bildatei ist für sich nicht sichtbar. Um sichtbar zu werden, benötigt sie ein Medium, wie z.B. einen Monitor, einen Drucker oder einen Dreifarblaser. Da jedes dieser Medien seine eigenen Charakteristika aufweist, ist die Wiedergabe der Datei jeweils unterschiedlich und stellt somit immer nur eine Annäherung an das eigentliche (unsichtbare) Bild dar. Die Ausbelichtungen sind zwar das sichtbare Korrelat der Datei, aber für sich ersetzbar, da jederzeit ein neuer Print gefertigt werden kann. Am ehesten entsprechen die Datei und ihre identischen Kopien einem Original und nicht die ausbelichteten Prints. Wer über die Datei verfügt, verfügt über das Kunstwerk. Dies birgt natürlich auch die Gefahr des Mißbrauchs in sich; daher müssen die Dateien vom Künstler – in seinem Sinne wie auch in dem des Sammlers – sorgfältig vor fremden Zugriff geschützt werden. Johanna Jacob |

||||||